« Un bébé ne naît pas biaisé. Il le devient par ses expériences et ce qu’on lui apprend. Au même titre, les algorithmes ne naissent pas biaisés, ils le deviennent », affirme le journaliste et conférencier Corey Patrick White au sujet des biais algorithmiques. Dans le monde technocratique d’aujourd’hui, les algorithmes ont une place de premier plan dans la manière dont nous vivons. Or, ces algorithmes sont construits sur des biais humains, qui perpétuent des stéréotypes et causent des préjudices.

Eloïc Potel est étudiant au baccalauréat en journalisme à l’UQAM. Passionné de politique, il affectionne la couverture des enjeux sociaux et politiques du Québec.

Dans le climat informationnel et médiatique d’aujourd’hui, au sein duquel les médias socionumériques et les nouvelles en continu occupent un espace considérable, tout le monde peut parfois se retrouver rapidement surchargé d’information. Dans ces cas, où il fait face à une telle surcharge, le cerveau humain a recours à des biais cognitifs, qui agissent comme des raccourcis pour mieux catégoriser et comprendre l’information qui lui est présenté.

Le cerveau utilise différents types de biais, qui malgré leur fonction de vulgarisateurs mentaux, sont susceptibles de nous placer à la merci de la désinformation lorsqu’on y succombe.

« Les biais sont une ‘‘responsabilité commune’’ généralement considérée comme l’intrusion inappropriée d’une opinion subjective au sein d’un compte rendu factuel » selon les études réalisées par les experts depuis 30 ans.

Le raccourci dangereux des biais cognitifs

- Biais de confirmation: le biais de confirmation explique le favoritisme dont profiterait un contenu qui confirmerait nos croyances personnelles idéologiques ou politiques. C’est un raccourci qui permet de se rassurer soi-même et de se confirmer que l’on a raison. Il octroie une fausse impression d’objectivité, et contribue à renforcer le phénomène de la chambre d’écho.

- Biais émotionnel: le biais émotionnel utilise la corde sensible des émotions pour crédibiliser la visibilité d’un contenu aux yeux du public. Le public considère davantage un contenu qui fait appel aux émotions fortes et laisse une impression : il sera davantage interpelé par un contenu chargé en émotions. Ce biais explique la popularité forte des fausses nouvelles en ligne, car les fausses nouvelles font souvent appel aux émotions pour gagner en traction sur les plateformes.

- Biais d’intentionnalité: nous avons tendance à croire que les choses ne sont pas le fruit du hasard, mais bien d’un complot ou d’une intention plus large. Ce raccourci explique l’adhésion aux théories du complot et l’association directe de phénomènes banals à des théories non reliées.

- Effet de halo: l’effet d’halo est une généralisation abusive causée par le jugement d’une personne ou d’une situation en fonction d’une seule caractéristique. Par exemple, quelqu’un à qui on présente un article journalistique couvrant une manifestation pourrait croire que les manifestants sont tous violents en raison d’un seul élément violent isolé parmi les milliers de personnes sur place.

- Angle mort: l’angle mort représente la croyance que les biais sont une réalité qui se limite aux autres et que nous ne sommes pas touchés personnellement. Il créé une fausse impression d’impartialité de soi et d’innocence erronée.

Quand les biais humains s’infiltrent dans la technologie

Les algorithmes sont au coeur du fonctionnement des appareils que nous utilisons au quotidien. Que ce soit sur les médias sociaux afin d’axer les recommandations de contenu aux utilisateurs, sur les boutiques en ligne pour proposer des produits aux acheteurs ou dans la bureaucratie gouvernementale, les algorithmes sont omniprésents. On les retrouve même dans le processus d’embauche d’entreprises.

Or, les algorithmes sont développés par des humains, qui leur transmettent parfois inconsciemment certains biais: les algorithmes sont donc tributaires des biais humains. Toutefois, ce sont surtout les biais structurants ou systémiques de la société qui se trouvent à polluer les algorithmes.

Ces algorithmes sont devenus biaisés en héritant des biais sociétaux.

Le journaliste et conférencier Corey Patrick White explique le phénomène : « Un bébé ne naît pas biaisé. Il le devient, par ses expériences et ce qu’on lui apprend. Au même titre, les algorithmes ne naissent pas biaisé, ils le deviennent », soutient-il. Le résultat est une propagation de certains stéréotypes au sein des algorithmes, qui se manifeste par une hiérarchisation de contenu souvent influencée par les « biais inhérents aux structures sociétales, comme la discrimination, le racisme ou le classisme ».

Discrimination et invisibilité

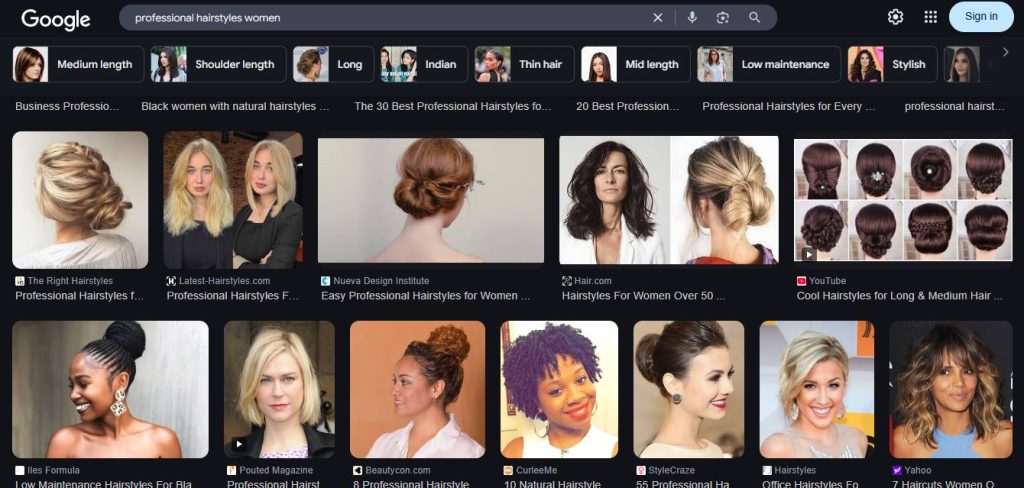

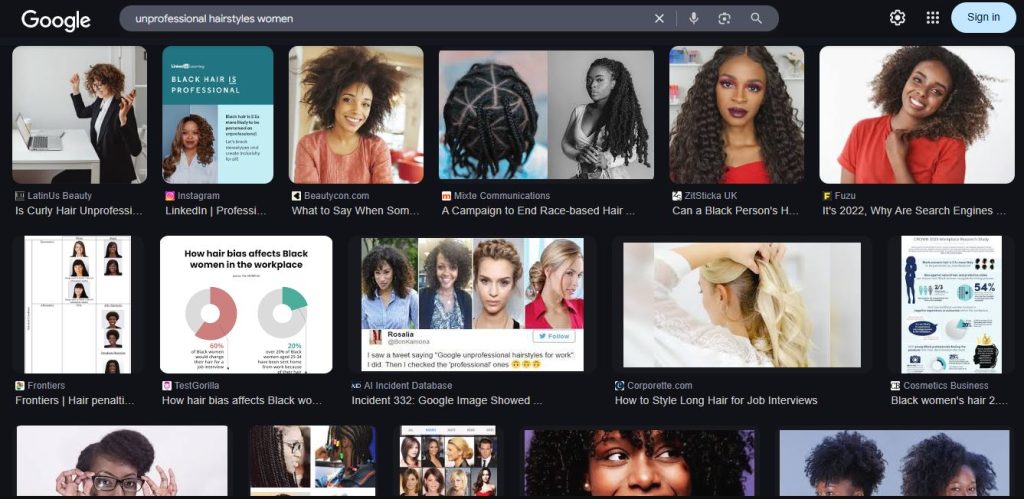

Pour être témoin de ces biais algorithmiques, il suffit de se diriger vers Google, le champion en titre des recherches Internet. Par une simple recherche (sur un navigateur privé vierge sans préférences précédentes) des termes « style de coiffure professionnelle pour femme » et puis « style de coiffure non professionnelle pour femme », on constate que les résultats pour la deuxième recherche montrent surtout des coiffures associées aux personnes racisées, tandis que les résultats de la première recherche mettent davantage en vedette les coupes de cheveux blondes, brunes ou noires typiquement associés aux personnes blanches.

Ici, l’algorithme ne fait que mettre en pratique les biais sociétaux sur lesquels repose sa base de données.

Les biais algorithmiques se révèlent aussi lors de l’embauche de candidats pour un poste au sein d’une entreprise. Avant 2018, le géant américain Amazon utilisait un algorithme d’embauche qui montrait une préférence envers les candidats masculins. L’algorithme, qui filtrait les candidatures automatiquement, avait été entraîné à l’aide de candidatures masculines sur une période de dix ans: il a appris à discriminer les candidatures féminines. L’histoire avait fait couler beaucoup d’encre, ce qui a mené Amazon à abandonner cette pratique.

En bref…

« Le biais algorithmique est un problème que notre espèce n’a jamais connu par le passé, mais ce n’est que le miroir d’un problème, ou une tache, qui existe depuis le tout début de l’existence de notre espèce », résume Corey Patrick White. Les biais algorithmiques ne sont que le reflet de stéréotypes enracinés dans la société et leurs conséquences sont discriminatoires envers certains groupes marginalisés.

Bibliographie

Thibault Grison (2024). Faire dire, faire taire. La modération (algorithmique) de contenus au prisme des sexualités [Thèse, Université Sorbonne]. https://theses.fr/s382382

Safiya Umoja Noble. (2018). Algorithms of oppression. NYU Press. https://nyupress.org/9781479837243/algorithms-of-oppression/

Stocking, S. Holly & Gross, Paget H. (1989) How Do Journalists Think? A Proposal for the Study of Cognitive Bias in Newsmaking. ERIC. https://eric.ed.gov/?id=ED309463

Nicolaï Abramovich et al. (2022). Explorer les biais cognitiffs. Guide pratique des biais cognitifs. https://www.shortcogs.com/

Queen’s University. (2025, 14 mars). Bias in AI design. Queen’s university library. https://guides.library.queensu.ca/ai/ethics

James Manyika. (2019). What Do We Do About the Biases in AI? Harvard Business review. https://hbr.org/2019/10/what-do-we-do-about-the-biases-in-ai

Corey Patrick White (2021, 1er juillet). How Algorithms Spread Human Bias [Document audiovisuel]. TEDx Talks. Youtube. https://www.youtube.com/watch?v=1z9KsNoAmFA

Zhisheng Chen (2023). Ethics and discrimination in artificial intelligence-enabled recruitment practices. Humanities & Social Sciences Communications. https://www.nature.com/articles/s41599-023-02079-x

Matthew G. Hanna et al. (2025). Ethical and Bias Considerations in Artificial Intelligence/Machine Learning. ScienceDirect. https://www.sciencedirect.com/science/article/pii/S0893395224002667

Nations Unies. (2025, 5 février). How AI reinforces gender bias—and what we can do about it. United Nations Women. https://www.unwomen.org/en/news-stories/interview/2025/02/how-ai-reinforces-gender-bias-and-what-we-can-do-about-it

Jeffrey Dastin. (2018). Amazon scraps secret AI recruiting tool that showed bias against women. Reuters. https://www.reuters.com/article/world/insight-amazon-scraps-secret-ai-recruiting-tool-that-showed-bias-against-women-idUSKCN1MK0AG/

Statista. (2025, 23 janvier). Market share of leading desktop search engines worldwide from January 2015 to January 2025. Statista institute. https://www.statista.com/statistics/216573/worldwide-market-share-of-search-engines/